10/03/2026

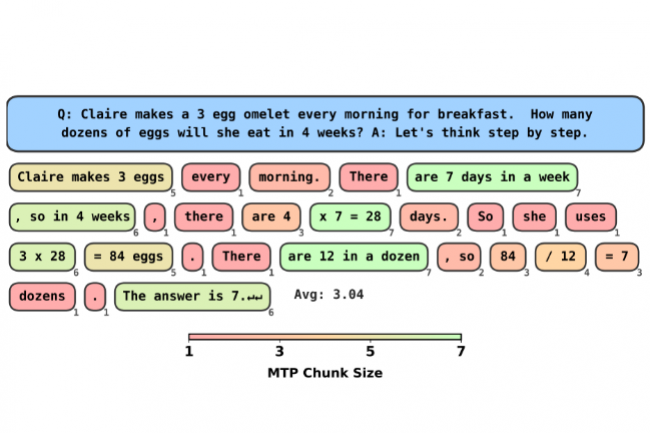

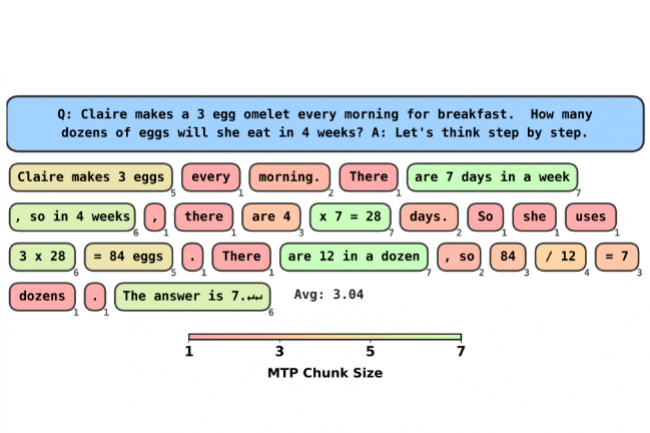

Des chercheurs optimisent l'inférence via la génération multi-token

La forte latence de l’inférence et la spirale des coûts des GPU sont devenues les principaux obstacles au déploiement de systèmes (…)

Source : www.lemondeinformatique.fr