27/03/2026

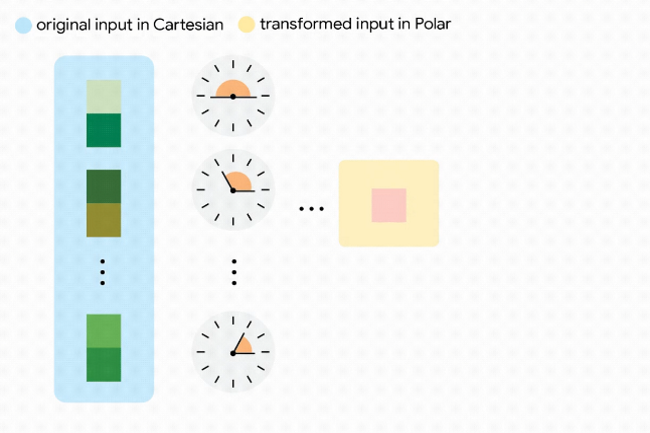

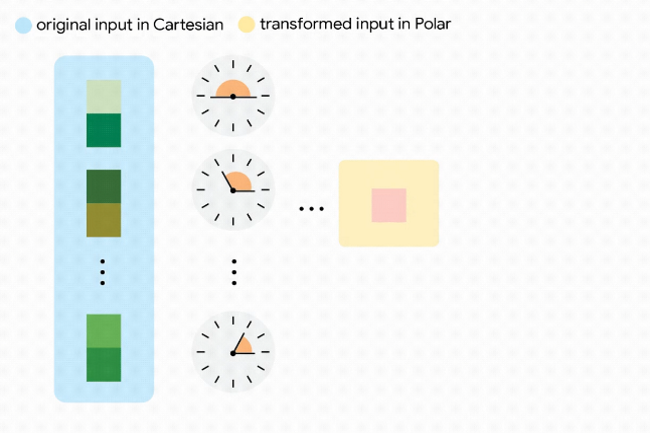

Google optimise la mémoire cache des LLM avec TurboQuant

Face à des pénuries de composants, les entreprises IT travaillent pour optimiser les modèles IA et les rendre moins gourmands en ressources. (…)

Source : www.lemondeinformatique.fr